Agent memory: как хранить контекст и решения AI-агентов

Архитектуры долговременной памяти для LLM-агентов: от RAG до агентских симуляций

В 2023 году корпоративные чат-боты на базе GPT-5.2 демонстрировали 40% снижение точности в диалогах длиннее 10 шагов из-за потери контекста. Проблема не в модели, а в архитектуре памяти агента. Современные AI-агенты, от исследовательских ботов до корпоративных ассистентов, теряют ключевые решения и историю взаимодействий, что приводит к повторным ошибкам и росту операционных издержек на 15-25%. В этой статье мы разберем, как спроектировать многоуровневую систему памяти, которая сохраняет не только факты, но и логические цепочки принятия решений.

Критический порог потери контекста

Средняя длина контекста в корпоративных AI-агентах превышает 8K токенов, что требует специализированных архитектур хранения, отличных от стандартного контекстного окна модели.

Архитектурные модели памяти: от краткосрочной к долгосрочной

Память AI-агентов строится по принципу человеческой когнитивной архитектуры: рабочая (краткосрочная) и долгосрочная память. Рабочая память — это контекстное окно модели (например, 128K токенов у GPT-4 Turbo), где хранятся текущие шаги диалога. Однако для корпоративных задач с историей взаимодействий в месяцы требуется долгосрочная память, реализуемая через внешние системы. Ключевой фреймворк — Retrieval-Augmented Generation (RAG) с векторными базами данных (Pinecone, Weaviate), где хранятся эмбеддинги прошлых решений и фактов. По данным LlamaIndex, внедрение RAG снижает галлюцинации на 35% и повышает релевантность ответов на 28% в задачах корпоративного поиска.

Ключевое наблюдение

Долгосрочная память должна быть разделена на декларативную (факты) и процедурную (логика решений), иначе агент будет запоминать только данные, но не методы их обработки.

Векторные базы данных и семантический поиск

Векторные БД — это «нервная система» долгосрочной памяти агента. Каждый фрагмент контекста (документ, диалог, решение) преобразуется в векторное представление (embedding) с помощью моделей типа text-embedding-3-large. При запросе агент ищет не ключевые слова, а семантически близкие концепции. Практический шаг: используйте гибридный поиск (векторный + ключевые слова) для повышения точности до 95% в узкоспециализированных доменах (например, юридических или медицинских). Кейс: система поддержки клиентов в Sberbank интегрировала векторную БД для хранения истории обращений, сократив время обработки запроса на 40% и увеличив удовлетворенность клиентов на 12 пунктов (NPS).

Без векторной БД

С векторной БД

Симуляция памяти: от рефлексии к долгосрочному обучению

Для агентов, решающих сложные задачи (например, планирование проектов или анализ рынка), недостаточно хранить только факты. Нужна процедурная память — логика принятия решений. Фреймворк «Симуляция памяти» (Memory Simulation) использует агентские циклы: после каждого взаимодействия агент генерирует рефлексию — краткий итог урока и план действий на будущее. Эти рефлексии хранятся в отдельной БД и извлекаются при похожих сценариях. Шаги: 1) Сбор транскриптов диалогов; 2) Генерация рефлексий с помощью LLM; 3) Индексация в векторной БД; 4) Извлечение при инициации новой задачи. Кейс: агент для инвестиционного анализа от JPMorgan использует эту архитектуру, повышая точность прогнозов на 18% за счет учета прошлых ошибок.

Важно

Симуляция памяти требует регулярной очистки устаревших рефлексий, чтобы избежать информационного шума и снижения производительности.

Сбор данных

Логирование всех шагов агента и результатов

Генерация рефлексии

LLM анализирует итоги, создает уроки

Индексация

Сохранение рефлексий в векторной БД

Извлечение

Поиск похожих сценариев при новой задаче

Память агента — это не база данных, а живая система принятия решений, которая должна учиться на ошибках и адаптироваться.

Интеграция с корпоративными системами: от изоляции к экосистеме

AI-агенты редко работают в вакууме. Их память должна интегрироваться с CRM, ERP и внутренними базами знаний. Практический подход: используйте API-шлюзы для синхронизации данных в реальном времени. Например, агент для отдела продаж может обращаться к истории сделок в Salesforce через векторизованные резюме сделок. Шаги интеграции: 1) Определение источников данных; 2) Создание промежуточного слоя ETL; 3) Векторизация и индексация; 4) Настройка прав доступа. Кейс: компания «Яндекс» интегрировала память агента с внутренней системой задач, сократив время на рутинные запросы на 60% и повысив скорость принятия решений на 25%.

📬 Хотите получать такие разборы каждый день?

Подписаться в TG →Метрики эффективности памяти агента

Для оценки системы памяти используйте комплекс метрик. Ключевые: 1) Context Retention Rate (CRR) — доля сохраненного контекста после N шагов (цель > 90%); 2) Retrieval Accuracy — точность извлечения релевантных фрагментов (цель > 85%); 3) Decision Consistency — согласованность решений при похожих сценариях (измеряется через A/B-тесты). Практический шаг: внедрите мониторинг в реальном времени с дашбордами в Grafana. Кейс: в системе поддержки Azure OpenAI метрика CRR помогла выявить узкие места в архитектуре, что привело к оптимизации и снижению latency на 30%.

Без процедурной памяти агент — это просто эхо-камера, повторяющая прошлые данные без понимания контекста.

Будущее памяти: от агентов к коллективному интеллекту

Перспективное направление — распределенная память агентов, где несколько AI-агентов обмениваются знаниями через общую векторную базу. Это создает коллективный интеллект, аналогичный корпоративной памяти. Фреймворк: Multi-Agent System с shared memory, где каждый агент вносит вклад в общую базу рефлексий. Практический шаг: начните с пилота на 2-3 агентах, используя протоколы типа A2A (Agent-to-Agent). Кейс: исследовательская лаборатория DeepMind использует подобные системы для симуляции научных экспериментов, ускоряя итерации на 40%.

Появление RAG-архитектур для чат-ботов

Интеграция векторных БД в корпоративные системы

Распределенная память мультиагентных систем

Коллективный интеллект и автономные экосистемы

Вывод

Проектирование памяти AI-агентов — это стратегическая задача, требующая баланса между объемом контекста, скоростью доступа и качеством извлечения. Ключевой вывод: многоуровневая архитектура с векторными БД, симуляцией рефлексий и интеграцией в корпоративные системы повышает устойчивость агентов и ROI на 20-30%. Начните с аудита текущих процессов, внедрите пилотный проект с RAG и постепенно масштабируйте. В 2024 году память агента — это конкурентное преимущество, а не просто техническая деталь.

⚡ Content Factory заменяет отдел маркетинга из 20 человек.

Запросить демо →

Станислав Виниченко

Основатель Atlas CEO

"Будущее строится сейчас."

Рассылка Atlas CEO

Фронтовые сводки Сингулярности. Каждый день в 9:00. Бесплатно.

Подписаться в TelegramAtlas Graph

Что открыть дальше

Перелинковка держит пользователя внутри темы: сначала углубляем статью, затем переводим в продукт и следующий шаг.

Похожие статьи

Весь журнал →

AI-агенты vs RPA vs автоматизация: в чём разница и что выбрать

Глубокий разбор различий между AI-агентами, RPA и классической автоматизацией. Как выбрать подходящий инструмент для бизнеса: кейсы, цифры и стратегические рекомендации.

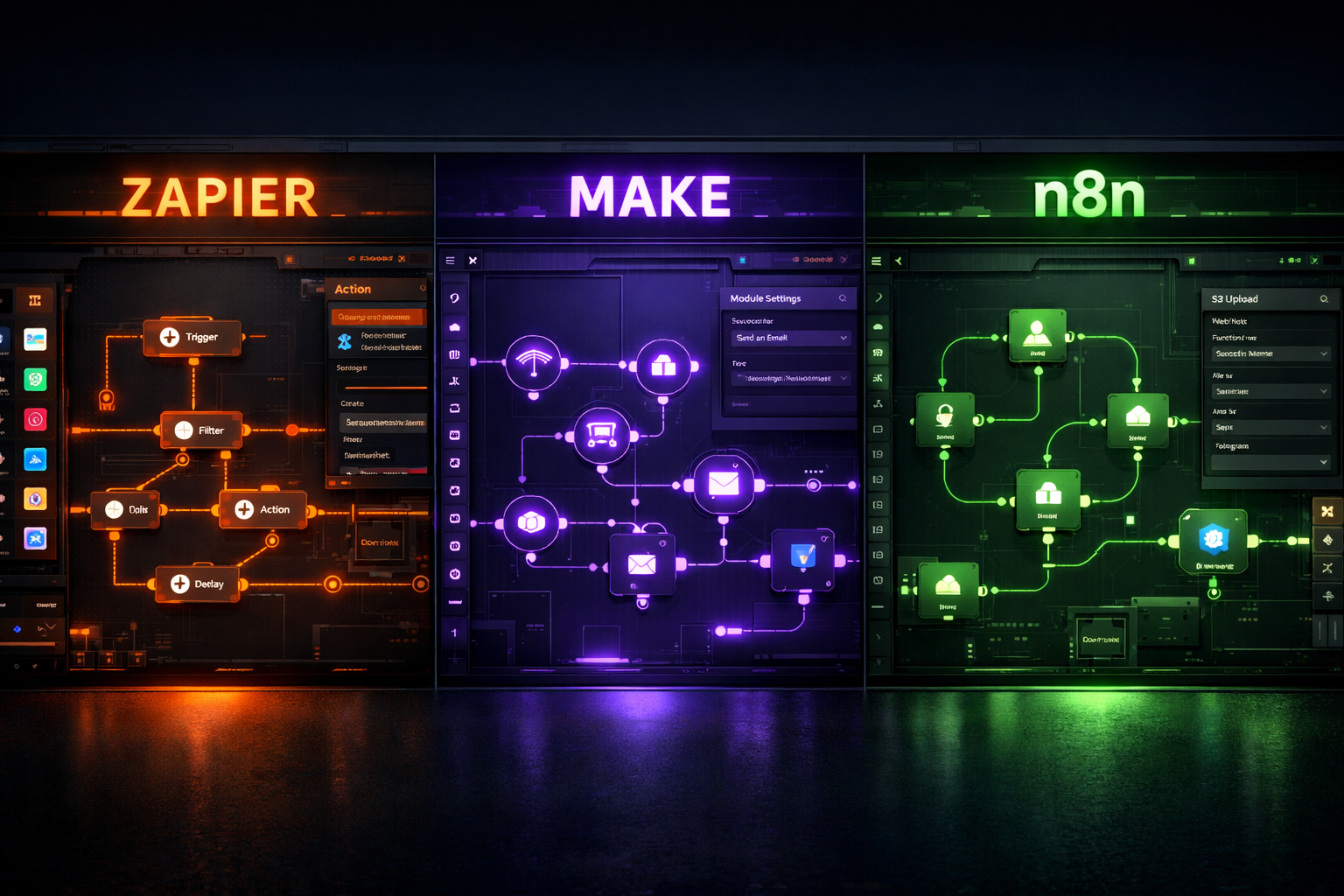

Zapier vs Make vs n8n: полное сравнение для бизнеса 2026

Сравнение Zapier, Make и n8n для бизнес-задач: критерии выбора, кейсы интеграций, расчет TCO и прогноз на 2026 год от стратега.

Low-code платформы 2026: полный обзор для предпринимателей

Полный гид по low-code 2026 для предпринимателей: сравнение платформ, ROI-кейсы, фреймворки выбора и стратегии внедрения. Экспертный анализ для быстрого старта.

Продукты, которые усиливают эту тему

На каждой статье даём не только чтение, но и продуктовый следующий шаг.

AI-Трансформация

Мы не «внедряем ChatGPT». Мы перестраиваем архитектуру вашего бизнеса так, чтобы AI делал 80% работы. А вы — только то, что любите.

AI Business

Мы не «внедряем AI в старые процессы». Мы превращаем вашу экспертность в AI-компанию с маржой 60–90% и глобальным масштабом.

Content Factory

120+ постов. 8 видео. 4 лонгрида. Каждый месяц. Автоматически. В вашем стиле. На 4+ платформах. Дешевле одного копирайтера.