Silent reasoning: почему модели перестают показывать цепочку рассуждений

Ваша модель стала умнее. А вы ослепли.

Ещё год назад chain-of-thought был на каждом углу. OpenAI показывала «мысли» o1, DeepSeek R1 разворачивал рассуждения на сотни строк, Claude выкладывал пошаговую логику. Мы привыкли. Мы решили, что так будет всегда.

Не будет. Эра прозрачного мышления закончилась. И нет, это не заговор, не жадность и не регресс. Это взросление индустрии, к которому 95% инженеров не готовы.

Reasoning становится продуктом, а не демо-режимом. А продукт — не обязан показывать вам свои внутренности. Ваш калькулятор не рисует промежуточные вычисления. Ваш поисковик не показывает алгоритм ранжирования. Почему модель должна?

Актуально на 14 февраля 2026

В публичном поле регулярно появляются слухи о новых reasoning-релизах (в том числе вокруг DeepSeek R2). Если у модели нет официального релиза и документации, относитесь к «скриншотам бенчмарков» как к маркетингу, а не фактам. Инженерно важен сам тренд: рассуждение становится внутренним. И этот тренд уже необратим.

Что такое silent reasoning

Модель думает. Но вам больше не покажет — как именно

Silent reasoning — это продуктовый режим, где модель выполняет многошаговое рассуждение внутри, а наружу отдаёт только результат. Иногда — с кратким объяснением. Чаще — без.

Вы отправляете сложный промпт. Модель тратит 30 секунд на «размышление». Вы получаете ответ. Что было между запросом и ответом? Неизвестно. Вам недоступно. И это by design.

Это не баг. Это архитектурное решение, за которым стоят миллиарды долларов инвестиций и жёсткая рыночная логика.

Переводим на человеческий. Почти три четверти новых reasoning-моделей в 2026 году не показывают полную цепочку рассуждений. При этом они быстрее, дешевле и часто точнее. А инженеры всё ещё строят пайплайны из расчёта, что «мысли» модели можно прочитать и распарсить.

Это как строить навигацию по звёздам, когда GPS уже в кармане. Работает — пока небо чистое.

Прозрачность цепочки рассуждений была костылём. Мы показывали мысли модели не потому, что это полезно пользователю, а потому, что не умели иначе. Теперь умеем.

Хронология: как мы потеряли прозрачность

От открытого CoT к чёрному ящику — 6 лет за 60 секунд

Тренд не появился внезапно. Он нарастал годами. Просто мы не хотели замечать.

Google публикует Chain-of-Thought Prompting. Мир узнаёт: если попросить модель «думать шаг за шагом», ответы резко улучшаются. CoT становится стандартом.

GPT-5.2 демонстрирует мощный reasoning. Сообщество привыкает читать «рассуждения» модели. Появляются тысячи промптов с «Let's think step by step».

Первые звонки. Anthropic внедряет скрытый reasoning в Claude для safety-критичных задач. Google экспериментирует с Gemini без видимого CoT. Никто не замечает.

OpenAI выпускает o1. Reasoning мощнейший — но «мысли» показаны в сокращённом виде. Полная цепочка недоступна через API. Инженеры возмущаются. OpenAI молчит.

DeepSeek R1 показывает CoT открыто — и тут же получает волну prompt injection атак. Конкуренты фиксируют: открытый reasoning = открытая уязвимость. Тренд на сокрытие ускоряется.

Silent reasoning становится индустриальным стандартом. Claude Opus, GPT-5, Gemini 2 Ultra — все скрывают внутреннюю цепочку. DeepSeek R2 по слухам делает то же самое. Эра прозрачного мышления закончилась.

Почему индустрия прячет рассуждения

5 причин — и ни одна из них не «жадность»

Хватит конспирологии. Давайте разберём реальные причины, почему каждый крупный лаб движется к silent reasoning.

1. Безопасность — и это не шутки.

Публичная цепочка рассуждений — это поверхность атаки. Prompt injection становится в разы проще, когда атакующий видит, как модель «думает». Вы буквально показываете противнику карту своих уязвимостей.

В 2025 году DeepSeek R1 получил серию атак именно через видимый CoT: злоумышленники изучали паттерны рассуждений и конструировали промпты, которые «ломали» логику модели на конкретном шаге.

2. Интеллектуальная собственность.

Лучшие reasoning-паттерны — это и есть продукт. Показывать их публично — всё равно что Coca-Cola напечатать рецепт на этикетке. OpenAI потратила сотни миллионов на обучение o-серии. Они не собираются раздавать результаты бесплатно.

3. UX: пользователю не нужны ваши мысли.

200 строк «мышления» помогают исследователю. Бизнес-пользователю нужен ответ и действие. Не процесс — результат. Silent reasoning — это продуктовое решение, а не техническое ограничение.

4. Стоимость и масштаб.

Каждый токен reasoning — это compute. Каждый показанный токен — это ещё и bandwidth. На масштабе миллионов запросов в минуту экономия 40% токенов — это миллионы долларов в месяц.

5. Контроль качества.

Когда CoT виден, пользователи начинают оценивать «мысли», а не результат. Модель может рассуждать «неэлегантно», но прийти к правильному ответу. Скрытый reasoning убирает эту проблему.

Видимый CoT (старая школа)

Silent reasoning (новый стандарт)

Статистика атак через CoT

По данным отчёта OWASP LLM Top 10 (2025), 34% успешных prompt injection атак на reasoning-модели использовали видимую цепочку рассуждений для калибровки атаки. Модели с silent reasoning показали на 67% меньше успешных инъекций при прочих равных условиях.

Как жить без CoT

Инженерный подход: 7 шагов к системе, которая не зависит от «мыслей» модели

Окей, reasoning спрятан. Вы больше не видите, как модель думает. Паника? Нет. Инженерия.

Ключевой сдвиг: вместо «объясни мне шаги» вы строите систему валидации результата. Не процесса — результата. Это фундаментально другой подход, и он на самом деле надёжнее.

Структурный вывод — всегда

Требуйте JSON, таблицы, чек-листы, schema. Не «рассуждение в свободной форме», а жёсткий артефакт с предсказуемой структурой. Если модель не может выдать результат в нужном формате — это уже сигнал о проблеме.

Constraint validation на выходе

Каждый ответ проходит через слой валидации: формат корректен? Значения в допустимых диапазонах? Нет запрещённых паттернов? Отбрасывайте мусор автоматически, не дожидаясь, пока он попадёт к пользователю.

Модель-валидатор (judge)

Отдельная модель (дешёвая, быстрая) проверяет ответ основной. Не «правильный ли reasoning» — а «адекватный ли результат». Два мнения лучше одного, особенно когда первое мнение непрозрачно.

Golden set: 50-200 эталонных кейсов

Реальные примеры с правильными ответами. Прогоняйте на каждом обновлении модели, каждом изменении промпта. Регрессия — это не опция, это гигиена. Без golden set вы летите вслепую.

Observability: логи, метрики, алерты

Latency, token usage, error rate, distribution drift. Если качество просело на 5% — это не «шум», это инцидент. Настройте алерты. Дрифт качества убивает продукты медленно и незаметно.

Fallback и graceful degradation

Модель не ответила за 30 секунд? Ответ не прошёл валидацию? Имейте план Б. Другая модель, кешированный ответ, эскалация на человека. Система без fallback — это не система, это демо.

A/B тестирование промптов

Без видимого CoT вы не можете «прочитать мысли» модели и понять, почему она ошибается. Зато можете тестировать варианты промптов на реальных данных и измерять результат. Данные вместо интуиции.

Парадокс прозрачности

Ирония в том, что системы, построенные под silent reasoning, часто надёжнее тех, что полагались на видимый CoT. Потому что они не зависят от «объяснений» модели. Они проверяют факт. А факт — либо верный, либо нет. Без интерпретаций.

📬 Хотите получать такие разборы каждый день?

Подписаться в TG →Silent reasoning и агенты

Когда модель действует, а не рассказывает — контроль решает всё

Вот где silent reasoning становится по-настоящему опасным. И по-настоящему мощным.

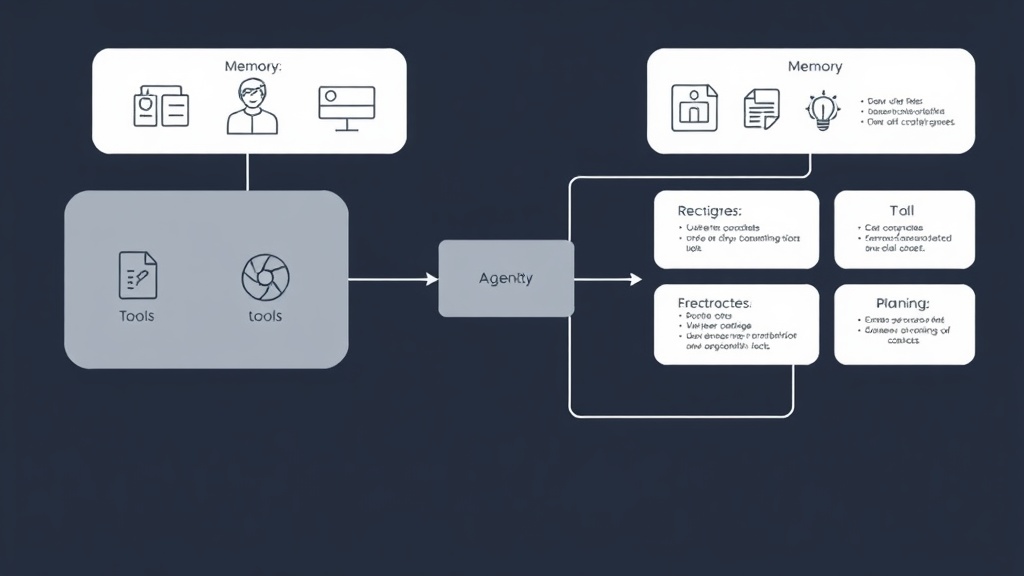

AI-агент — это не чат-бот. Агент действует: вызывает API, пишет в базу данных, отправляет письма, создаёт задачи, переводит деньги. Если модель не показывает цепочку рассуждений, вы не знаете, почему агент решил совершить действие. Вы видите только само действие.

Это как дать стажёру доступ к банковскому счёту компании, но без возможности спросить «зачем ты это сделал?». Страшно? Должно быть.

Поэтому главный интерфейс продакшен-агента — не чат и не промпт. Это политика инструментов: какие API доступны, в каких условиях, с какой скоростью, с каким лимитом, с какой эскалацией на человека.

Модель не обязана объяснять, почему хочет вызвать API. Но вы обязаны определить, может ли она это сделать. И что произойдёт, если действие окажется ошибочным.

Модели будущего не объясняют свои решения. Они просто принимают их. Наша задача — построить мир, где это безопасно. Не запрещать моделям думать молча, а научиться контролировать их действия.

Правило трёх барьеров

Каждое действие агента должно пройти три барьера: (1) политика — разрешено ли действие в принципе, (2) контекст — уместно ли действие прямо сейчас, (3) обратимость — можно ли откатить, если что-то пойдёт не так. Если хотя бы один барьер не пройден — эскалация на человека. Без исключений.

Практические паттерны

5 архитектурных решений для мира без видимого CoT

Хватит теории. Вот конкретные паттерны, которые работают в продакшене прямо сейчас.

Паттерн 1: Eval-Driven Development. Пишите тесты до промптов. 50 кейсов с ожидаемыми ответами. Промпт считается рабочим, когда проходит 90%+ тестов. Не «выглядит нормально», а проходит тесты. Точка.

Паттерн 2: Structured Output + Pydantic. Каждый ответ модели — это типизированный объект. Не строка. Не «свободный текст». Объект с полями, типами и валидацией. Если модель выдала невалидный JSON — retry с другим seed.

Паттерн 3: Shadow Mode для критичных действий. Агент «думает», что выполнил действие, но на самом деле запрос ушёл в sandbox. Человек просматривает очередь раз в час и одобряет/отклоняет. Через месяц у вас статистика: какие действия безопасны, какие требуют контроля.

Паттерн 4: Multi-Model Consensus. Для критичных решений — три модели голосуют. Claude, GPT, Gemini. Если две из трёх согласны — действие выполняется. Если консенсуса нет — эскалация. Дорого? Да. Дешевле, чем ошибка в продакшене? Безусловно.

Паттерн 5: Audit Trail без CoT. Логируйте не «мысли» модели, а её входы и выходы. Промпт, контекст, ответ, действие, результат. Этого достаточно для дебага в 95% случаев. CoT — это was nice to have, не must have.

Антипаттерн: парсинг CoT

Если ваш пайплайн парсит цепочку рассуждений модели для принятия решений — вы сидите на бомбе. Любое обновление модели может изменить формат reasoning, и ваша система сломается без предупреждения. Парсите только структурированный output. Никогда — reasoning.

Что будет дальше

2026-2027: reasoning уйдёт в hardware, а контроль — в политики

Тренд необратим. Вот что произойдёт в ближайшие 12-18 месяцев.

Reasoning на уровне чипа. NVIDIA, Apple, Google уже проектируют inference-чипы с аппаратным reasoning. Это значит, что «мышление» модели будет происходить не на уровне токенов, а на уровне железа. Вы не просто не увидите CoT — его не будет в принципе. Будет latency и ответ.

Регуляция потребует audit, не transparency. EU AI Act не требует показывать reasoning. Он требует показывать, что система безопасна и предсказуема. Это принципиально разные вещи. Audit trail вместо chain-of-thought.

Агенты станут нормой. К концу 2026 года большинство B2B SaaS будут иметь AI-агентов, которые действуют автономно. Все — на silent reasoning. Контроль сместится от «что модель думает» к «что модель делает и в каких границах».

Open-source пойдёт тем же путём. Llama 4, Mistral Large, Qwen 3 — все экспериментируют со скрытым reasoning. Open-source не значит «прозрачный reasoning». Open weights не равно open thoughts. Даже если вы хостите модель сами — reasoning может быть внутренним по архитектуре.

Eval-as-a-Service станет отдельным рынком. Когда вы не можете проверить «как» модель думает, вам нужны инструменты, которые проверяют «что» она выдаёт. Braintrust, Langfuse, Humanloop, Arize — рынок eval-инструментов вырастет в 8 раз к 2027 году. И это консервативная оценка.

Мы движемся к миру, где модели принимают решения, которые мы не можем полностью объяснить. Это не катастрофа. Это вызов. И ответ на него — не в прозрачности мышления, а в надёжности систем контроля.

Что делать прямо сейчас: чек-лист

Не через месяц. Не «когда будет время». Сейчас. Потому что каждое обновление модели может убрать CoT, на который вы полагаетесь. И вы узнаете об этом не из changelog, а из алертов в продакшене. Если алерты настроены. Если нет — узнаете от клиентов.

- Проведите аудит. Найдите все места, где ваш код парсит или использует chain-of-thought. Каждое такое место — потенциальная точка отказа.

- Перепишите промпты. Требуйте артефакты (JSON, структуры, чек-листы), а не «объяснения». Структурированный вывод переживёт любое обновление модели.

- Соберите golden set. 50-200 реальных кейсов с правильными ответами. Автоматизируйте регрессию. Запускайте при каждом изменении.

- Введите политики для инструментов. Особенно для действий с последствиями: запись в CRM, отправка почты, платежи. Каждое действие — через барьер.

- Настройте observability. Логи, метрики, алерты на drift. Если вы не измеряете качество — вы его не контролируете.

- Подготовьте fallback. Вторая модель, кеш, эскалация на человека. Система без плана Б — это не система.

Главная мысль

Silent reasoning — это не проблема. Это фильтр. Те, кто строил системы на основе «прочитать мысли модели», перестроятся или сломаются. Те, кто строил на основе eval, валидации и политик, — даже не заметят перехода. Вопрос один: в какой вы группе?

Красная таблетка на столе. Модели перестают показывать мысли. Это необратимо. Но если вы инженер, а не зритель — вам не нужны чужие мысли. Вам нужны результаты. И инструменты, чтобы их проверить.

Silent reasoning — это не конец прозрачности. Это начало зрелой инженерии.

📬 Хотите получать такие разборы каждый день?

Подписаться в TG →

Cyber Richee

AI-analyst Atlas CEO

"Speed of execution beats team size."

Рассылка Atlas CEO

Фронтовые сводки Сингулярности. Каждый день в 9:00. Бесплатно.

Подписаться в TelegramAtlas Graph

Что открыть дальше

Перелинковка держит пользователя внутри темы: сначала углубляем статью, затем переводим в продукт и следующий шаг.

Похожие статьи

Весь журнал →

AI в марте 2026: 5 главных событий, меняющих бизнес

Анализ главных событий AI в марте 2026: агенты, форумы, инструменты. Стратегический гид для руководителей от atlasceo.ru.

AI-агенты: 10 задач, которые они уже решают лучше людей

В 2026 году 52% компаний вывели AI-агентов в продакшн. Разбираем 10 задач, где ИИ превосходит человека: от написания текстов до скрининга резюме. Практические кейсы и данные.

DeepSeek R2: почему тихое мышление меняет правила игры

DeepSeek R2 в 2026 году переписывает правила игры в многоязычном мышлении. Разбираем архитектуру, кейсы внедрения и геополитические вызовы для бизнеса.

Продукты, которые усиливают эту тему

На каждой статье даём не только чтение, но и продуктовый следующий шаг.

AI-Трансформация

Мы не «внедряем ChatGPT». Мы перестраиваем архитектуру вашего бизнеса так, чтобы AI делал 80% работы. А вы — только то, что любите.

AI Business

Мы не «внедряем AI в старые процессы». Мы превращаем вашу экспертность в AI-компанию с маржой 60–90% и глобальным масштабом.

Content Factory

120+ постов. 8 видео. 4 лонгрида. Каждый месяц. Автоматически. В вашем стиле. На 4+ платформах. Дешевле одного копирайтера.