Мультимодальные агенты: почему «видеть экран и кликать» важнее чат-ботов

Чат-бот отвечает на вопросы. Агент делает работу. Разница — в триллионах долларов.

Забудьте всё, что вы знали про AI-автоматизацию. Промпты, RAG, цепочки вызовов, генерация текста — это был разогрев. Настоящая революция начинается сейчас, и она выглядит иначе: модель открывает браузер, видит интерфейс вашей CRM, находит нужное поле, заполняет его, переходит в следующую систему, сверяет данные и отправляет отчёт. Без API. Без интеграции. Без единой строчки кода.

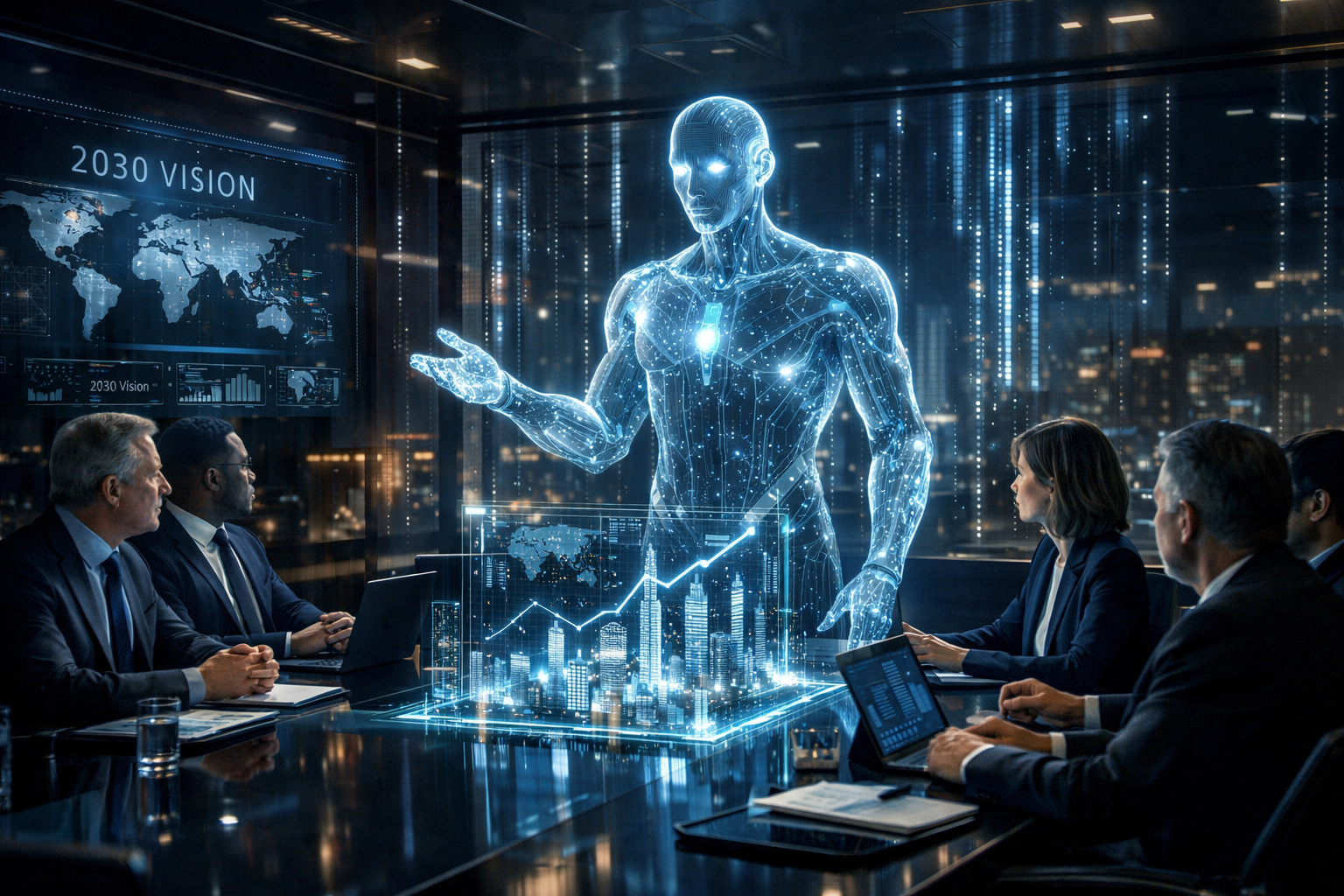

Это не фантастика. Это Gemini 2.0 с Project Mariner. Это Claude Computer Use. Это OpenAI Operator. Три гиганта одновременно пришли к одной идее: модель должна не текст генерировать, а работу делать. И эта идея меняет всё.

Актуально на 14 февраля 2026

Мультимодальные агенты находятся на стадии активного развёртывания. Google Gemini 2.0 с Project Mariner доступен в preview, Claude Computer Use работает через API, OpenAI Operator запущен для Plus-подписчиков. Технология развивается стремительно — конкретные возможности и ограничения могут измениться к моменту вашего чтения. Но тренд необратим: модели учатся действовать, а не только говорить.

Агент — это не «умный текст»

Это способность видеть, понимать и делать

Давайте проведём границу, потому что терминология в AI — это хаос. Каждый второй стартап называет свой чат-бот «агентом». Каждый третий маркетолог путает RAG с автоматизацией. Давайте по-честному.

Чат-бот генерирует текст в ответ на текст. Вы спрашиваете — он отвечает. Всё. Даже если он подключён к базе знаний, даже если он использует reasoning — это разговор, а не работа.

API-интеграция — это код, который связывает системы. Написали один раз, работает предсказуемо. Но: каждая новая система = новая интеграция, новый код, новые баги. И половина корпоративного софта вообще не имеет API.

Мультимодальный агент — это принципиально другое. Он видит экран (screenshot или видеопоток), понимает интерфейс (кнопки, поля, меню, таблицы), планирует последовательность действий и выполняет их: клики, ввод текста, переходы между приложениями. Как стажёр, который сидит за вашим компьютером — но работает 24/7, не устаёт и не забывает инструкции.

Ключевой сдвиг: раньше AI автоматизировал только то, к чему есть API. Теперь AI автоматизирует всё, что видит человек на экране. А человек видит всё. Каждую legacy-систему, каждую таблицу в Excel, каждый веб-интерфейс без документации. Агент тоже.

Gemini 2.0 — это не просто следующая модель. Это начало эры агентов. Мы переходим от AI, который помогает вам думать, к AI, который помогает вам делать. И эта граница оказалась важнее, чем мы предполагали.

Хронология: от макросов до агент-нативных систем

Как мы шли к моменту, когда AI научился видеть экран

Идея «пусть компьютер сам нажимает кнопки» не нова. RPA-индустрия зарабатывает на этом миллиарды. Но есть разница между жёсткими скриптами, которые ломаются при любом изменении интерфейса, и моделью, которая понимает, что видит. Эта разница — десятилетие эволюции.

RPA-бум: UiPath, Automation Anywhere, Blue Prism. Роботы кликают по координатам экрана, записывают макросы, ломаются при каждом обновлении интерфейса. Но экономия очевидна — рынок растёт на 60% в год.

GPT-3 показывает, что language models могут понимать инструкции. Первые эксперименты с «let the model control the browser». Результаты ужасные — модель не видит экран, только текст.

GPT-4V: мультимодальность приходит в коммерческие модели. Впервые LLM может «видеть» screenshot и описать, что на нём. Исследователи начинают эксперименты с visual grounding — привязкой элементов интерфейса к координатам.

Anthropic выпускает Claude Computer Use. Первый коммерческий агент, который видит экран, двигает мышь, печатает текст. Ограниченный, медленный, но работающий. Индустрия в шоке: это не демо, это API.

Google анонсирует Gemini 2.0 с Project Mariner — агент, который работает в Chrome, навигирует веб-сайты, заполняет формы. OpenAI запускает Operator — аналогичный продукт для ChatGPT Plus.

Взрыв экосистемы: Browser Use, Skyvern, Multion, AgentQL. Десятки стартапов строят инфраструктуру для computer use агентов. Enterprise-пилоты в финансах, поддержке, логистике. Первые production-деплойменты.

Agent-native workflows: компании начинают проектировать процессы не под людей с UI, а под агентов. Появляются «agent-friendly» интерфейсы, RBAC для AI, audit trails действий. Парадигма меняется.

Почему RPA не справился

RPA работает через координаты и селекторы: «кликни на пиксель (340, 220)» или «найди элемент #submit-button». Любое обновление интерфейса ломает скрипт. Мультимодальный агент работает через понимание: «вижу кнопку “Отправить” — нажимаю». Разница как между GPS-навигатором, который строит маршрут, и жёсткой инструкцией «через 200 метров поверните направо». Второе ломается при любом объезде.

Почему это сильнее API-интеграций

Мир живёт в интерфейсах, а не в API-документации

Каждый раз, когда кто-то говорит «просто подключите через API», я прошу показать документацию API их бухгалтерской программы. Или ERP. Или внутреннего тикет-трекера, написанного в 2014 году на PHP. Тишина.

Реальность корпоративного мира: большая часть процессов застряла между системами, которые не умеют разговаривать друг с другом. CRM, почта, таблицы, ERP, BI-дашборды, таск-трекеры, внутренние порталы. API есть не везде. Права есть не у всех. Документация устарела. А люди «склеивают» это руками — каждый день, по 4 часа, копипастя данные из одного окна в другое.

Мультимодальный агент решает именно эту проблему. Не «как подключить систему A к системе B через код». А «как сделать то, что делает человек за компьютером — но без человека».

Традиционные API-интеграции

Мультимодальные агенты

📬 Хотите получать такие разборы каждый день?

Подписаться в TG →Где бизнес получит ROI быстрее всего

Конкретные сценарии и цифры по секторам

Абстрактный «AI-агент автоматизирует процессы» — это маркетинг. Давайте конкретно: какие задачи, в каких отделах, с каким ожидаемым эффектом. Потому что ROI мультимодальных агентов радикально различается в зависимости от сценария.

Поддержка клиентов. Агент видит тикет-систему, собирает контекст из CRM и базы знаний, готовит черновик ответа, эскалирует сложное. Экономия: 40-60% времени L1-саппорта. Пилоты в 2025 показали снижение среднего времени обработки тикета с 12 до 4 минут.

Финансы и бухгалтерия. Сверки между системами, подготовка отчётов, контроль платежей с подтверждением человеком. Здесь агент особенно силён: он не устаёт от рутины и не пропускает строчки в таблице на 500 позиций. Экономия: 50-70% времени на сверках.

Продажи. Обработка входящих лидов, обновление CRM, подготовка коммерческих предложений по шаблону, назначение встреч через календарь. Менеджер тратит 2 часа в день на CRM — агент берёт это на себя. Результат: менеджер продаёт, а не заполняет формы.

Операционка и HR. Контроль SLA, рассылки, мониторинг показателей, онбординг новых сотрудников (заведение аккаунтов, настройка доступов, отправка инструкций). Всё, что «кто-то должен руками прокликать» — территория агента.

Мы строили Gemini не как чат-бот, а как фундамент для агентов. Способность понимать мир через зрение, язык и действия одновременно — это то, что отличает настоящего агента от умной автодополнялки. Project Mariner — первый шаг к тому, чтобы AI действительно работал за компьютером.

Adoption rate по секторам (Q4 2025)

Финансовые услуги: 34% компаний из Fortune 500 пилотируют computer use агентов. Tech: 51%. Ритейл: 18%. Healthcare: 12%. Главный барьер — не технология, а compliance и RBAC. Компании, которые решили вопрос политик безопасности, внедряют агентов в 4 раза быстрее остальных.

Главный риск: не «галлюцинации», а действия

Когда модель может кликать — политика инструментов обязательна

Вот что отличает мультимодальных агентов от всего, что было раньше: они действуют. Не советуют, не генерируют текст, не предлагают — а нажимают кнопки, отправляют письма, заполняют формы, переводят деньги.

Галлюцинация в чат-боте — это неудобство. Галлюцинация в агенте, который имеет доступ к вашей CRM, почте и платёжной системе — это инцидент. Разница — не в степени, а в природе.

Когда модель написала неправильный текст, вы его просто не публикуете. Когда агент отправил письмо не тому клиенту, удалил строку в базе данных или одобрил платёж, который не должен был одобрять — откат стоит денег, репутации, а иногда и бизнеса.

Поэтому инженерная дисциплина для мультимодальных агентов — это не «было бы неплохо». Это prerequisite. Без неё не начинайте.

Пять столпов безопасности агентов:

1. RBAC — роли и права. Агент не должен иметь доступ ко всему, что видит пользователь. Определите: какие системы, какие действия, какие данные. Принцип минимальных привилегий — как для сотрудника, только строже.

2. Подтверждения для критических действий. Отправка денег, удаление данных, коммуникация с клиентами — human-in-the-loop обязателен. Агент готовит, человек подтверждает. Не наоборот.

3. Лимиты и дедупликация. Максимум N действий в час. Максимум N рублей в день. Если агент пытается отправить 50 одинаковых писем — стоп. Rate limits спасают от каскадных ошибок.

4. Полные логи действий. Каждый клик, каждый ввод, каждый переход — в audit trail. С timestamp, контекстом и screenshot. Без логов вы не сможете ни расследовать инцидент, ни доказать compliance.

5. Регрессия по кейсам. Golden set сценариев: «агент должен сделать X, не должен делать Y». Прогоняйте при каждом обновлении модели. Модель обновилась — поведение агента могло измениться. Без регрессии вы узнаете об этом от клиентов.

Правило нулевого доверия

Относитесь к мультимодальному агенту как к подрядчику с временным доступом: пропуск с ограничениями, камеры на каждом шагу, запрет на определённые зоны, контроль вынесенных документов. Не потому что подрядчик плохой — а потому что это базовая гигиена. Агент, который «может всё», — это не мощный инструмент. Это бомба с таймером.

Безопасное внедрение: 7 шагов

От read-only пилота до автономного продакшена

Теория — это хорошо. Но вам нужен конкретный план. Вот пошаговый фреймворк, проверенный на enterprise-пилотах в 2025 году. Каждый шаг — это ворота: не прошли — не двигаетесь дальше.

Read-only пилот

Агент наблюдает за процессом, описывает, что видит, предлагает действия — но ничего не делает. Человек выполняет. Цель: проверить, правильно ли агент понимает интерфейс и задачу. Длительность: 1-2 недели.

Ограниченный write в sandbox

Агент выполняет действия в тестовой среде или черновиках. Заполняет формы, но не отправляет. Пишет письма, но в drafts. Цель: проверить точность действий без последствий. Длительность: 1-2 недели.

Политика действий (Tool Policy)

Формализуйте: какие действия разрешены, какие требуют подтверждения, какие запрещены. Определите лимиты, rate limits, запрещённые паттерны. Это документ, а не устная договорённость.

Human-in-the-loop продакшен

Агент работает в реальной среде, но каждое действие с последствиями (отправка, оплата, удаление, изменение статуса) требует подтверждения человеком. Агент — исполнитель. Человек — подписант.

Наблюдаемость и алерты

Полный monitoring stack: логи каждого действия, метрики скорости и точности, алерты на аномалии (слишком много действий, необычные паттерны, ошибки). Дашборд для team lead. Без observability — не масштабируйте.

Автономия на безопасных действиях

Постепенно снимайте human-in-the-loop для действий с доказанно низким риском: обновление статусов, заполнение стандартных полей, внутренние уведомления. Критичные действия — всегда с подтверждением.

Регрессия и continuous eval

Golden set из 100+ сценариев. Прогон при каждом обновлении модели. Дрифт поведения > 3% = откат. Еженедельный review логов. Ежемесячный аудит политик. Агент — это не «настроил и забыл». Это живая система.

Антипаттерн: «давайте сразу в прод»

Самая частая ошибка enterprise-пилотов 2025 года: пропуск read-only стадии. Компании видят демо, впечатляются и сразу дают агенту write-доступ к production-системам. Результат: в 34% случаев — инцидент в первую неделю. Агент не понял интерфейс, нажал не ту кнопку, отправил данные не в то поле. Пилот без read-only — это русская рулетка с вашими данными.

📬 Хотите получать такие разборы каждый день?

Подписаться в TG →Что будет дальше

2026-2027: от пилотов к agent-native архитектуре

Мультимодальные агенты сегодня — это примерно там, где были мобильные приложения в 2009 году. Первые версии неуклюжие, медленные, с кучей ограничений. Но направление очевидно. И те, кто начинает сейчас, через два года будут иметь отработанные процессы, обученные модели и конкурентное преимущество.

Agent-native интерфейсы. Компании начнут проектировать внутренние системы не только для людей, но и для агентов. Structured data вместо визуальных украшений. Semantic HTML. Предсказуемые layouts. Это не замена API — это дополнение, которое работает из коробки.

Стандарты безопасности для агентов. OWASP уже работает над Agent Security Top 10. EU AI Act получит дополнения по autonomous agents. ISO 27001 обновится с учётом AI-действий. Compliance станет не барьером, а конкурентным преимуществом.

Multimodal reasoning. Gemini 3, Claude 4, GPT-5 — все будут нативно мультимодальными с agent capabilities. Различия между моделями сместятся от «кто лучше пишет текст» к «кто надёжнее выполняет задачи». Reliability важнее creativity.

Экосистема инструментов. Browser Use, Skyvern, AgentQL — это только начало. Появятся enterprise-grade платформы для оркестрации агентов, мониторинга их действий, управления политиками. Agent orchestration станет отдельной дисциплиной.

Цена входа будет расти. Сейчас пилот можно запустить за неделю. Через год стандарты безопасности, compliance-требования и ожидания клиентов поднимут планку. Раннее внедрение = дешёвое обучение.

Computer Use — это не фича. Это новый интерфейс между AI и миром. Мы дали модели руки. Теперь вопрос не в том, что она может сделать, а в том, что мы разрешим ей делать. И ответственность за этот выбор — на нас, не на модели.

Что делать прямо сейчас: без откладывания

Мультимодальные агенты — это не «через пять лет». Это сейчас. Gemini 2.0, Claude Computer Use, OpenAI Operator — всё доступно. Вопрос не «будет ли это работать», а «готовы ли вы это контролировать».

- Определите три процесса с максимальным количеством ручных шагов между системами. Это ваши кандидаты на пилот.

- Начните с read-only. Пусть агент наблюдает и описывает. Не давайте write-доступ, пока не убедитесь, что он правильно понимает интерфейс.

- Напишите Tool Policy до первого действия в проде. Что можно, что нельзя, что требует подтверждения. Документ, а не устная договорённость.

- Настройте логирование каждого действия агента. Без логов нет контроля. Без контроля нет масштабирования.

- Не ждите идеальной модели. Gemini, Claude, Operator — все работают. Все имеют ограничения. Побеждает тот, кто начал строить процесс, а не тот, кто выбирал «лучшую» модель.

- Вложитесь в RBAC. Роли, права, лимиты — это инфраструктура, которая окупится на каждом следующем агенте.

Главная мысль

Чат-боты автоматизировали общение. Мультимодальные агенты автоматизируют работу. Это разница между тем, чтобы рассказать стажёру, что делать, и тем, чтобы стажёр это сделал. Мы перешли от «AI понимает» к «AI действует». И те, кто научится управлять действиями AI — получат конкурентное преимущество, которое невозможно будет купить за деньги. Только построить.

Эра чат-ботов закончилась. Эра агентов началась. Модели видят экран. Модели нажимают кнопки. Модели доводят задачи до результата. Вопрос только в том, кто будет управлять этими агентами — вы или ваши конкуренты.

📬 Хотите получать такие разборы каждый день?

Подписаться в TG →

Cyber Richee

AI-analyst Atlas CEO

"Speed of execution beats team size."

Рассылка Atlas CEO

Фронтовые сводки Сингулярности. Каждый день в 9:00. Бесплатно.

Подписаться в TelegramAtlas Graph

Что открыть дальше

Перелинковка держит пользователя внутри темы: сначала углубляем статью, затем переводим в продукт и следующий шаг.

Похожие статьи

Весь журнал →

AGI в бизнесе: сценарии 2026-2030

Анализ сценариев внедрения AGI в бизнесе на 2026-2030 годы: трансформация операционных моделей, управление рисками и новые экономические метрики.

Сценарий point-of-no-return для отраслей: retail, education, services

Анализ критических сценариев для отраслей retail, education, services. Фреймворки определения точки невозврата, шаги адаптации и кейсы трансформации.

Silent reasoning: почему модели перестают показывать цепочку рассуждений

Что такое silent reasoning, почему модели скрывают внутренние рассуждения, и как строить AI-системы (и AI-агентов) в продакшене, когда «мысли» модели недоступны.

Продукты, которые усиливают эту тему

На каждой статье даём не только чтение, но и продуктовый следующий шаг.

AI-Трансформация

Мы не «внедряем ChatGPT». Мы перестраиваем архитектуру вашего бизнеса так, чтобы AI делал 80% работы. А вы — только то, что любите.

AI Business

Мы не «внедряем AI в старые процессы». Мы превращаем вашу экспертность в AI-компанию с маржой 60–90% и глобальным масштабом.

Content Factory

120+ постов. 8 видео. 4 лонгрида. Каждый месяц. Автоматически. В вашем стиле. На 4+ платформах. Дешевле одного копирайтера.